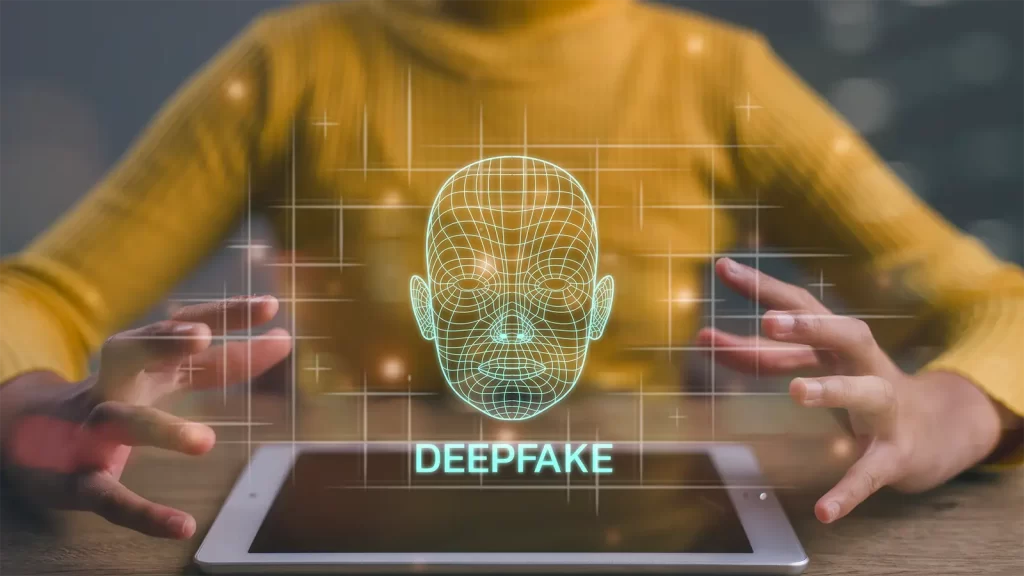

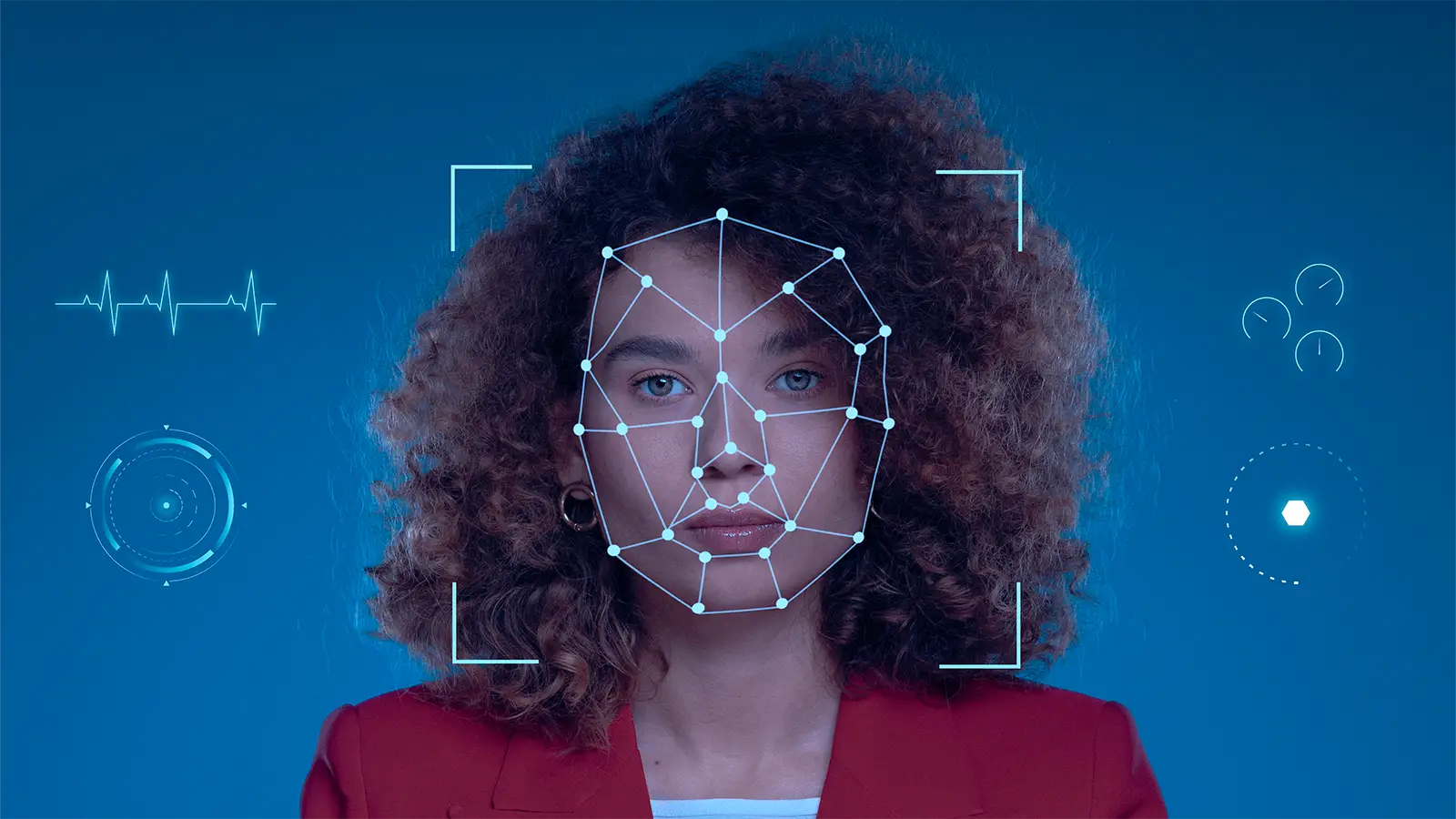

En un momento en el que la inteligencia artificial avanza a pasos agigantados, también crecen los riesgos y desafíos que trae consigo. Uno de los más alarmantes es el uso de la tecnología para crear imágenes falsas con fines sexuales y sin el consentimiento de la persona retratada. Este fenómeno, conocido como deepfake porn, ha afectado a miles de mujeres, adolescentes y hasta figuras públicas como Taylor Swift. Pero finalmente, una nueva ley federal promete cambiar las reglas del juego.

El pasado 19 de mayo, el presidente Donald Trump firmó oficialmente el Take It Down Act, una legislación que convierte en delito federal la publicación o amenaza de publicar imágenes íntimas no consensuadas, incluidas aquellas generadas con inteligencia artificial. Lo que antes era un problema regulado por algunos estados, ahora se convierte en una medida nacional con consecuencias reales para quienes violen esta ley.

¿Qué es el Take It Down Act?

El nombre completo de esta ley es “Tools to Address Known Exploitation by Immobilizing Technological Deepfakes on Websites and Networks” (de ahí su acrónimo, TAKE IT DOWN). En pocas palabras, busca proteger a personas —especialmente mujeres y menores— del abuso digital que se da cuando se publican o difunden imágenes íntimas sin su consentimiento, ya sean reales o creadas artificialmente.

La ley impone multas e incluso penas de cárcel a quienes cometan este tipo de delitos. También obliga a sitios web, plataformas digitales y aplicaciones a eliminar las imágenes ilegales en un plazo máximo de 48 horas después de que una víctima lo reporte. Además, deben asegurarse de que el contenido no vuelva a aparecer en otras versiones o copias.

Melania Trump y el poder de la primera dama

Una de las impulsoras más visibles de esta ley fue la primera dama, Melania Trump, quien utilizó su influencia política para apoyar el proyecto desde el Congreso. Aunque su firma en el documento es simbólica (las primeras damas no son funcionarias electas), fue parte del acto oficial en el Jardín de las Rosas de la Casa Blanca, y su participación fue clave en la aprobación bipartidista del proyecto.

En su discurso durante la ceremonia, Melania describió a la inteligencia artificial y a las redes sociales como “el dulce digital de la nueva generación”, advirtiendo que, aunque parezcan inofensivos, estos recursos pueden ser utilizados como armas que afectan la salud emocional y cognitiva de los niños.

Su participación se alinea con su campaña “Be Best”, una iniciativa que lanzó durante el primer mandato de Trump para enfocarse en el bienestar de los niños, el uso de las redes sociales y la lucha contra el abuso de opioides.

Un problema real que afecta a miles

El Take It Down Act no es una respuesta aislada: es una reacción a una problemática creciente y muy real. En enero de 2024, por ejemplo, se viralizaron en redes sociales imágenes falsas de la cantante Taylor Swift, creadas con inteligencia artificial y altamente explícitas. El escándalo obligó a la plataforma X (antes Twitter) a bloquear las búsquedas relacionadas con su nombre temporalmente.

Pero este no es un problema que solo afecte a celebridades. Muchas adolescentes en distintas partes de Estados Unidos han sido víctimas de este tipo de contenido. Uno de los rostros visibles de la campaña por la ley fue Elliston Berry, una joven de Texas que fue víctima de un deepfake generado por un compañero de escuela usando una foto de su Instagram. Ella fue invitada por la primera dama al discurso presidencial ante el Congreso, y también asistió a la firma de la ley.

“Todos los días viví con miedo de que esas imágenes volvieran a salir”, dijo Berry en una entrevista. “Con esta ley, ya no tendré que vivir con ese temor”.

¿Qué dice la ley y por qué es importante?

El Take It Down Act marca un antes y un después en la legislación estadounidense. Hasta ahora, solo existía una ley federal que protegía a menores contra deepfakes sexuales, pero no había una regulación clara para proteger a adultos. Ahora, cualquier persona puede denunciar el uso indebido de imágenes íntimas y exigir su eliminación.

Además, la ley obliga a las plataformas tecnológicas a actuar con rapidez, algo que hasta ahora no era uniforme. Aunque algunas empresas como Meta, Google y TikTok ya habían implementado formularios para solicitar la eliminación de este tipo de contenido, no todas las plataformas cooperaban ni respondían con la urgencia necesaria. Con esta nueva ley, ya no es opcional.

Incluso empresas como Apple y Google han comenzado a eliminar aplicaciones y servicios de sus tiendas que permiten manipular imágenes para simular desnudos. El mensaje es claro: ya no hay espacio para mirar hacia otro lado.

Críticas y preocupaciones

Aunque la ley fue aprobada casi por unanimidad (409 votos a favor y solo 2 en contra en la Cámara de Representantes), no está exenta de críticas. Algunos grupos de derechos digitales y defensores de la libertad de expresión advierten que la legislación podría ser demasiado amplia y provocar censura no deseada, afectando contenidos legales como material LGBTQ+ o pornografía consensuada.

Otros temen que pueda ser usada como pretexto para vigilar comunicaciones privadas o imponer límites a la libre expresión. Por eso, el reto ahora será implementar la ley sin pisar libertades fundamentales, pero manteniendo el enfoque en proteger a las víctimas.

Un paso necesario ante un nuevo tipo de violencia

En palabras de Ilana Beller, de la organización Public Citizen: “Las deepfakes íntimas no consensuadas son un daño claro, sin ningún beneficio social. Es el tipo de contenido que simplemente no debería existir”.

Y aunque ninguna ley es una solución mágica, el Take It Down Act representa un paso enorme hacia un internet más seguro y responsable. Es, como dijo Melania Trump, una victoria nacional y, más importante aún, una forma de decirle a las víctimas: no están solas.

Leave a Reply